For the English version of this article, please click here.

2020年1月11日,由腾讯研究院主办的第三届 ” 科技向善 ” 年度论坛在北京举办,本届论坛以「千里之行·Action Now」为主题,聚焦科技向善的行动路径,分享国内外先进案例和最新研究成果。

MIT物理学终身教授、生命未来研究所创始人Max Tegmark 在会上发表主题演讲《人类的下半场:我们如何与科技和平相处》。

Max认为,人工智能正变得强大,这种强大的力量带来了无数的便利与益处,但同时也产生了大量问题与挑战。面对这样的矛盾与困境,一方面要对技术的使用划分清晰的红线,规范界定技术使用的范围。另一方面,要提出与践行积极、共有的全球愿景,推动技术合作、普惠,以实现科技向善。

以下为演讲全文:

下午好,我会说一点普通话,可是说的不好,所以我现在切换成英文来跟大家进行演讲。

非常荣幸能够来到这里,今天我给大家带来的演讲题目是《人类的下半场:我们如何与科技和平相处》。在开始前,我想要引用美国最具智慧的以为当代哲学家的话作为开场——辛普森。

(辛普森说:“向酒致敬!所有我们生活当中遇到的问题,解决方案皆在酒中。”)

我觉得这个说法很有趣,如果我们把酒替换为人工智能的话,它仍然是成立的,这个比喻依然很有趣,因为我们的生活的方方面面都得益于AI。但是AI,甚至更广泛来讲,科技,也带来了很多困扰。同时,我们又有很多的技术可以解决这些问题,比如说今天我们就听到了许多可以解决痛点的技术。这就引出了我今天的主题:我们该如何让科技向善,并避免它带来的问题?

AI其实正变得越来越强大。大家可以设想一下:在不久之前,我们还没有可以走路的机器人,但现在机器人已经可以后空翻;过去我们没有自动驾驶的汽车,但现在我们有自动驾驶的火箭,这样的火箭可以通过AI自动降落;甚至不久之前,AI不能做到精准的人脸识别,但是现在AI不仅可以做到人脸识别,AI还可以模仿我们的脸,并说一些我们从未说过的话;之前AI在国际象棋比赛当中是没有办法打败人类的,但现在大家都知道Google DeepMind的AlphaGo颠覆了我们的认知,它学习了过去3000年中人类的围棋经验,并通过24小时的自我对战就成为了全世界最强的围棋手,并击败了人类。

所以不管是从国际象棋还是Alpha Go的比赛当中,我们都能看出AI已取得了非常大的进展。就连过去几十年里我们人工编写的一些算法,都被机器学习所替代。

由于技术的进步,人工智能可以解决我们很多的问题,也可以拯救人类的生命。大家都知道,每年在公路上会发生超过百万的死亡,但很快这些生命就可以通过自动驾驶的AI技术来拯救。而且AI可以降低医院中发生的人为错误。通过使用人工智能,我们可以提升诊断水平。现在有很多数据证明在前列腺癌、肺癌以及眼疾治疗当中,AI做的比人类更好。这不光涉及硬件层面,还有软件层面的进步。但是硬件也同样在进步,我们可以将那些庞大的超声机器替换为更精细化、更廉价、可以用于更多场景的机器。它们还可以接入云端,其诊断效果质量很高。

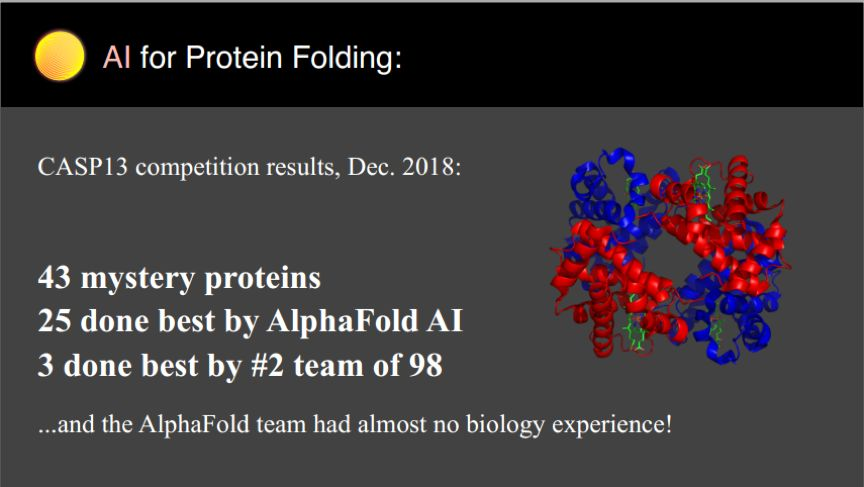

我认为人工智能还可以帮助我们促进医学研究,比如说生物学内最有名的待解问题——蛋白质折叠问题。血红细胞通过参与身体氧循环而使我们保持清醒,而血红蛋白的分子结构就像甜甜圈一样。我们是如何在只知道血红蛋白的基因代码的情况下,预测出它的分子结构呢?实际上,每年医学界都有比赛,业内专家会相互竞争有关蛋白质折叠的知识,而去年是第一次由AI赢得了这场比赛,那就是Google DeepMind的AlphaFold。

我们可以看到TDEL上面这层是氨基酸,它被用于预测氨基酸是如何进行三维折叠的。虽然其结果还有一些提升空间,但是这已经足够让我们振奋了。这个绿色的形态是我们用非常昂贵的测量仪测出的结果,蓝色是AI预测的结果,实际上两者已经非常接近。

这样的技术也非常有利于药物的研发,它可以代替一些非常慢且昂贵的实验室研究工作,而且它的应用快速且高效,部署起来十分容易。

以上我所讲的是AI在解决问题、向善方面的突破,但是AI这种技术不仅仅解决问题,也会带来问题。

AI人工智能会带来什么样的一些问题和挑战呢?大家可能都已经了解到,AI会操纵人,造成国家和人心的分裂。在很多地区,比如肯尼亚大选中,AI就火上浇油,带来了灾难性的后果。这是在委内瑞拉总统大选的时候,有人用AI、甚至无人机去刺杀总统。在也门也发生了一场暗杀,并且成功了。如果这种技术变得像手机一样平价、小巧,那么任何人只要讨厌别人,都可以用它去造成伤害。

另外,我们还可能面临经济损失,比如说一个叫做骑士资本的企业在一分钟的时间里因为交易失误导致了4.4亿多的头寸凭空消失,这就是交易失误所带来的一种灾难性后果。当然,这是骑士资本的个例,并不是AI自身的一个缺陷,而是人们不够了解AI导致的结果。

另外一个案例是波音737MAX,这架飞机从乌克兰起飞。具体情况我们现在还不能确定,但如果是因为它的一个自动化的防御系统关闭导致该架飞机坠落,那么这就又是一个因为不够理解自动AI技术而造成的惨剧。

有时,也有一些的确出于恶意的情况:AI为黑客和骗子提供了可乘之机,比如deepfake技术。

其实还有很多因为不够了解AI而导致失败的案例。AI有很多被袭击的可能,比如说对AI的伪造。这样的情况我们该如何杜绝呢?我们怎么样能够保持AI的积极作用而杜绝它的负面影响呢?

第一点,我们必须要划清界限,我们必须要去看AI能做的事情有什么,与此同时要把AI应用划分成可接受和不可接受的。

这样界限是什么样的呢?首先要有在文化层面中的定义,比如说哪些能做,哪些不能做,有些是道德标准,有些是国际公约等等,这些都是用以保证我们对AI的使用是可接受的。大家可能会说这样并不现实,没有任何的技术可以进行这样的划分。但我认为其实我们有很多的案例可以借鉴,比如生物学家就已经有很多成功的案例。他们在90年代的时候就划清了界限,知道哪些可做,哪些不可做。

比如Matthew Meselson,他致力于声讨生物武器。他说服了尼克松总统,然后像其他国际领导人提倡在国际上禁止生物武器。所以,今天当你在想起你那些生化领域内的朋友时,你会认为他们在使用这项技术拯救生命而非杀人。

我们要为所有的技术划这条红线,包括AI在内,因为它们都非常强大的,所以必须保证其为我们所用。

我们需要将AI调整到好的、积极的、正面的方向,但是AI的管理管控是全球性的挑战,因为技术是没有边界的。正因为技术没有国界线,所以单枪匹马、各自为政、各个国家关门作战是不可取的。

我觉得中国在这方面就扮演了非常重要的角色:管理AI,让AI朝着为我们所用的方向发展。我这样说不仅仅是因为中国让AI技术发展得更加强大,而是在于中国拥有长期思维和战略部署,以及长期的历史文化积淀。

所以,在这样拥有着五千年文明的国家演讲时,当我说到未来十年、几十年,说到长期规划的时候没有人会笑,因为大家都知道长期规划的重要性。而在西方,如果政治家讲到长期规划,大家都会低头玩手机,因为他们觉得不现实。可是在中国,如果中央政府想要筹划高铁项目,大家都会关注长期的愿景和规划。这是一种智慧,是一种世界应该向中国学习或从中受益的一种智慧。所以在发展人类命运共同体的时候,我们必须要去划清界限。

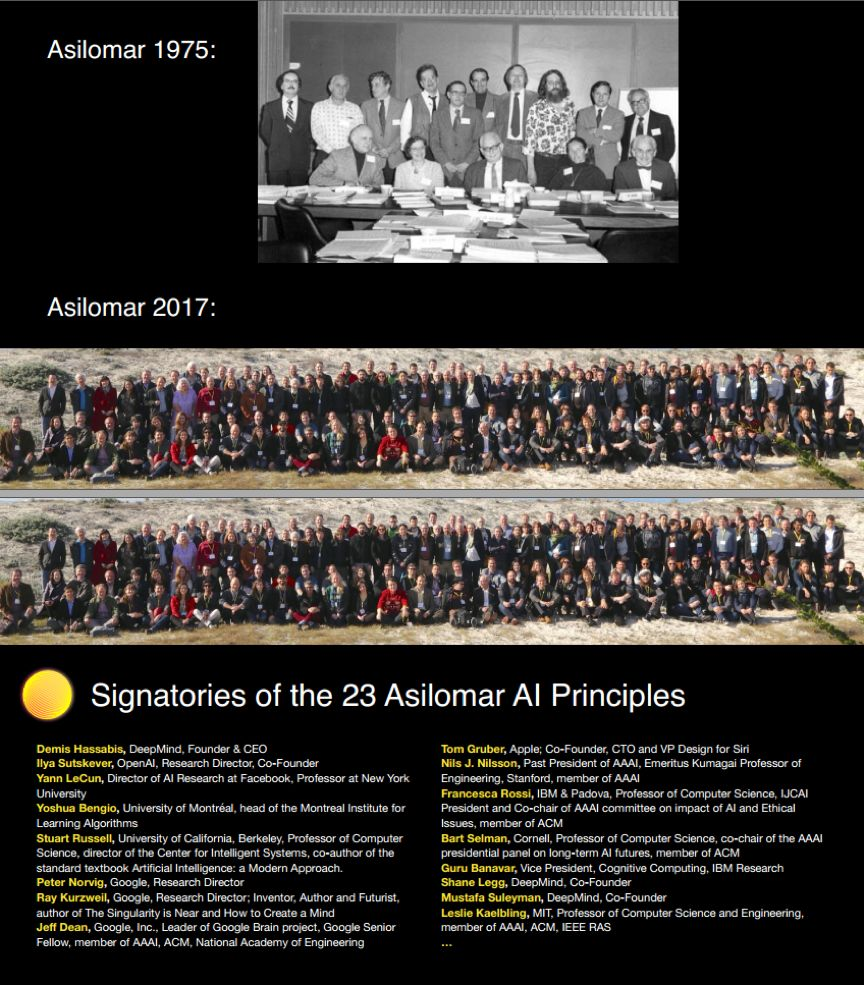

我们现在这个进行分享的过程不禁让我想到之前的一些案例。生物学家虽然禁止了生物武器,但是他们不止于此,他们还召开了很多会议。比如说1975年他们组织了阿西洛马大会,专家们聚集在一起讨论应该如何划定界限。

受到启发,我们在2017召开了AI领域的阿西洛马大会,并且讨论出了23条阿西洛马原则。其实这些原则已得到了进一步的拓宽和演进,包括腾讯的“四可”人工智能原则(可用、可靠、可知、可控)在内,有很多企业都有其自身向善的原则。

所以我们必须要划清一个界限,技术到底是向善的,还是向恶的。我们希望技术是能够更多地带来解药,而不是武器。我很高兴的一点是,前段时间我们做了一个调研,询问一些大公司是否有制造有害的自动化武器。

划这样一个界限的时候,我们应该不只是事后作为,而要提前行动。因为技术是随着时间不断地演进的,我们想要做到技术向善的关键在于赢得一场智慧竞赛。我们需要在技术日益丰满的羽翼之下,去与我们的智慧进行博弈,这样做的关键就在于要改变战略。

非常有意思的是,每次我在提这个观点时,大家都说不要这样去传播,这是一种谣言,是一种危言耸听。其实不然,这并不是在散布恐怖消息,实际在做一种安防工程。当NASA第一次送人类上太空时,他们系统性地思考任何一个可能出错的细节。这是在散播恐惧吗?不是的,这是为了保证成功完成任务的安全工程。

在过去,人类一直是从错误当中学习。比如在发明了火之后,我们用消防措施解决火带来的问题。之后我们又研发出了车,车出现问题后,我们就发明出了交通灯、信号灯以及安全带。这些都是切实有效的。

但是随着技术和科学日益强大,在一段时间后,我们发现只从错误当中学习是不够的。比如说,我们不能在有了核武器之后再从中学习。不能在核大战之后说:“下次我们小心点,我们从中学习嘛!”再比如一些合成生物,我们不可能在一些合成生物材料导致整个人类消失之后再去痛改前非。

同样,我们也不能造出比人类更加聪明的机器。这样非常强大的技术下,我们需要主动而非坐以待毙。我们需要想在之前,而且我们要在一开始就想对、做对,因为这可能是我们唯一的机会。

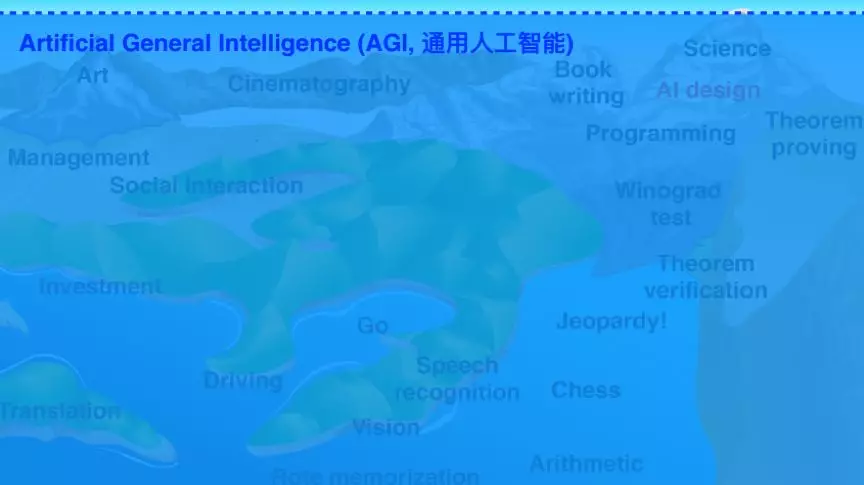

关于人类的下半场,我经常会考虑到当人类在处理各种问题时候的一些背景和我们所用到的一些能力。这就像是人工智能跟人工的对比:海拔代表着对于人工智能而言,想要做到人类能做到的事情有多难;海平面是指现在AI可以做什么。首先海平面是在上升的,而且随着人工智能越来越强大,海平面就越来越高。

我们会警告孩子,不要从事靠近“海边”的职业,因为这些职业可能会被自动化替代。自动化会带来颠覆,问题是水到底会涨到多高,水是否会淹没所有的土地呢?

当水淹没了所有的陆地,人工智能的智力与人类完全相当,这种情况就叫做通用人工智能,也就叫做AGI。有了这种定义后,过去说着“人在很多的工作中都会优于机器”的人,现在改口称“我们永远不会达到AGI这个层面”。

我并不是说AI会比人类工作得更好,但是我们要记得一个可能性叫做超级智能,也就是机器比人类做得更好,包括所有科技公司。哪怕你们是研究AI的,你们的工作和效率都不一定有AI高。这种情况下,更好的AI让海平面上升的幅度更快,而且节奏更快,同时它也会远远超过我们人类的能力。

这些只是科幻吗?还是我们要认真考虑的可能情况?如果未来真的会如此,到底多快会实现这样的情况呢?答案是我们所不知道的。

这个问题是我们的争议所在,我们有一个同事的观点是“300年都不可能实现,不用想了。”也有同事会开玩笑说:“担忧这个问题就好像再担忧火星人口过负一样。”另一方面,还有其他不同的观点,Google DeepMind的CEO Demis Hassabis说这很快会发生。先不说超级智能,人工智能的调研者发现,在几十年内人工智能就可以达到人类的水平。

如果机器真的可以比人类更加低价、高效地工作的话,我们的生活会变成怎样?这样,我们就面临一个很重要的选择:自满,还是野心勃勃。我们可以自满地说:“发明可以做所有事情的机器又怎样?我完全不担心后果。就算机器淘汰了所有人类,又能怎样呢?”或者是选择满怀雄心壮志:“让我们畅想一下高科技的未来吧。”

这就是我想说的第二点,怀有一个积极的愿景,因为只有这样我们才能合作。为什么人们会结婚,即使他们知道会损失一部分个人自由?因为我们有共同追求的积极愿景。为什么公司会合并?因为他们有共同的积极的愿景。

现在我们的积极愿景必须是全球共有的,我们知道技术是没有国界的,所这不是一个国家能够独善其身的事情。正如我前面提到的阿西洛马原则中的一条:“超级智能的发展必须也只能为全人类的福祉服务。”而不只是让一个国家或一小部分人受惠。

我看到习近平主席这句话,让我感到非常高兴,他是说人类是命运共同体。一些美国人爱说的美国人第一、美国人优先,这就形成了非常有意思的对比。在AI界,我们常说要惠及全人类,这和习近平主席的话是不谋而合的,我们不能只惠及自身、惠及本地。

我们也一直在举办论坛,很像这一次的科技向善大会。其中的一个重点就是要建立共同、共享、共有的积极愿景,我们的大会也有一些来自中国的嘉宾,这让我感到很高兴。

关于全球共有的愿景,我想再跟大家更多地介绍一下,比如这个例子:在1945年二战之后,我们知道战后的欧洲满目疮痍,他们感到非常的内疚,因为是欧洲人开始的二战。有的人开始想,如果说这次我们建立更加积极的技术愿景,不去研发那些武器呢?我们要通过更加积极的技术愿景让大家都能生活的更好、更健康、更自由,让大家拥有免费的医疗、免费的教育。

很多瑞典人说,你这个想法太梦幻了、太理想化了,是不可能实现。但是通过努力,我们的的确确实现了这样一个体制。瑞典向全世界展示实现这样一个体制是可行的,绝大部分欧洲国家纷纷效仿,也建立起了这样一些社会福利体系。所以对我来说,这是非常有启发的一个例子。如果我们建立了共同、共有的积极愿景,然后在这样的愿景下共同合作,其实欧盟也是这样一个拥有积极共同愿景的体系。

我们再看看AI领域是如何推动同积极愿景的。我们要怎样实现和谐3.0 AI积极愿景?怎样能够实现不止一个高福利体系,而是全球范围内的高福利体系?如果要实现这样的体系,我觉得AI有很多可以发挥作用的地方,比如促进商业发展、改善医疗、普及教育。

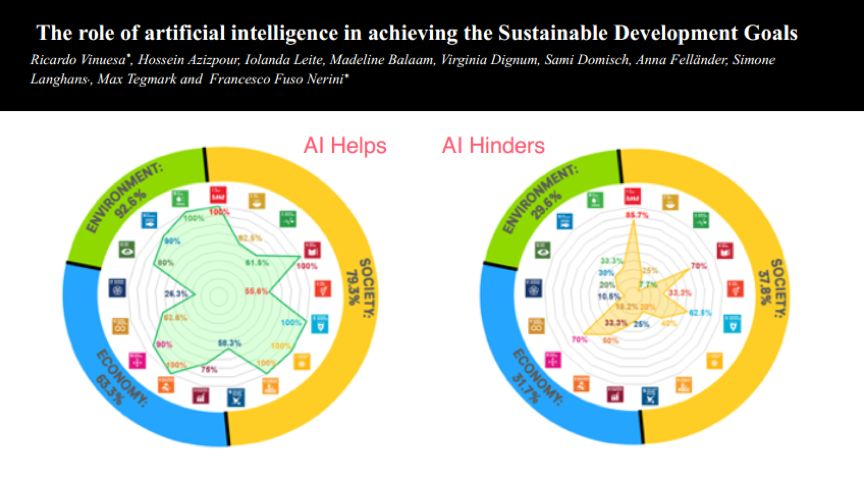

更加广泛地来说,有的人会认为全球的共享或共有的机会是不可能的。我觉得这种说法不对,我们现在已经有了很多全球性的积极愿景,比如欧盟的可持续发展目标。在实现这些可持续发展的目标之上,AI对每一个目标的实现都能发挥促进作用,但我们应该有更远大的目标,不仅仅局限于此。

这些目标将在2030年的时候实现,也就是10年后。但我们不能停留在这些目标上,我们还要继续,我们希望更快地实现这些目标。我们还可以建立更加远大的目标,而不是说只是减少不平等、减少贫困。我们要行动起来,应对气候变化,实现更加持续的地球。最终,我们还要使用人工智能治愈所有的疾病。许多疾病不是不能治愈,只是我们不够智能,还找不到治愈的方法,人工智能在这方面可以有所助益。我们可以建立这些远大的目标。

最后总结一下我前面讲的,第一,我们要真正实现人工智能的技术向善、和谐共存。这不仅仅是技术层面上,而更应该建立更广、更远大的目标。我们要画一条清楚的红线,规范什么是可接受的、什么是不可接受的。我们要有一个非常清晰的“停止指示灯”,来实现科技向善而非科技向恶。第二,我们要和技术和谐相处,我们需要的是共有、全球、积极的愿景。

最后,我们其实已经意识到,未来我们还会听到更多AI造成的问题。但只关注负面消息是无法促进合作的。如果说你这一辈子都在努力避免癌症、避免受伤,如果你总是在想负面的东西的话,你就很难活得开心。我们不能以这样的方式继续。相反,如果我们能够意识到积极的契机与愿景,那么在这宇宙起源以来的这么长时间里,我们将第一次真正把命运掌握在自己的手中。

我们不会再像石器时代那样只有29年的寿命,作为人类,我们能够打造自己想要的未来,并且创造前所未有的未来。这不仅仅局限于之后几年内,而是以后几百万年的时间。这不仅是在我们这颗星球上,而是在更远的宇宙中。谢谢大家!